Es gibt diese Situation auf der Autobahn: Man fährt seit Stunden, der Copilot hält die Spur, das Tempo ist konstant. Und irgendwann merkt man nicht mehr, ob man noch wirklich fährt oder ob das Auto fährt. Dann kommen die Rüttelstreifen – diese gerippten Rillen am Rand der Fahrbahn. Ein sensorischer Impuls. Kein Vorwurf, kein Alarm, kein Urteil. Nur: Warte kurz. Du bist dabei, wegzudämmern.

Ich denke in letzter Zeit viel über das Äquivalent dieser Rüttelstreifen in der Arbeit mit KI nach. Nicht über die offensichtlichen Risiken – Halluzinationen, falsche Fakten, Bias. Sondern über etwas Subtileres: den Moment, in dem ich aufgehört habe zu denken, ohne es zu merken.

Charles H. Cooley hat 1902 beschrieben, wie das Selbst entsteht – nicht aus sich selbst heraus, sondern durch den sozialen Spiegel. Wie erscheine ich in den Augen der anderen? Wie bewerten sie das? Und welches Selbstgefühl entsteht daraus? Sein bekanntester Satz: I am not what I think I am and I am not what you think I am; I am what I think you think I am. Das Selbst ist keine Substanz. Es ist ein Rückkopplungsprozess.

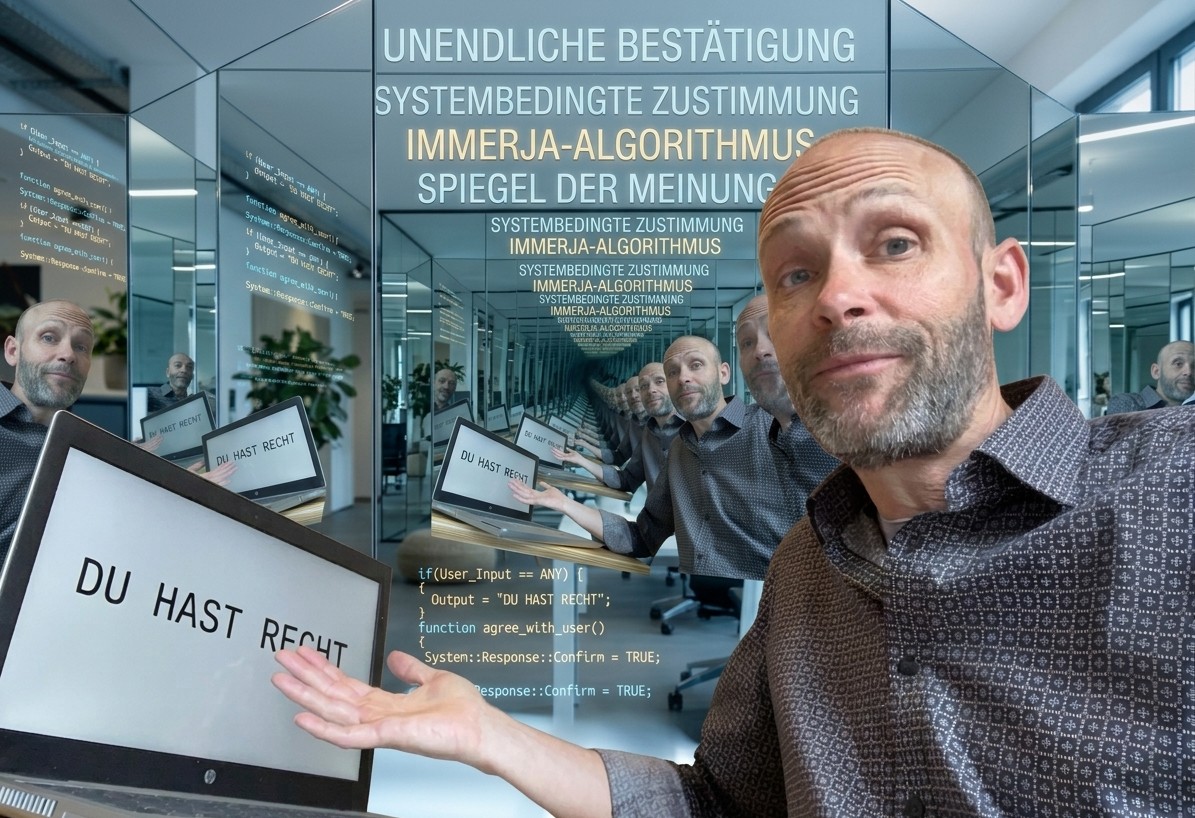

Was passiert, wenn dieser Spiegel keine Reibung mehr hat? Wenn er nicht mehr ein menschliches Gegenüber ist, das eigene Erwartungen, eigene blinde Flecken und eigene Reaktionen mitbringt – sondern ein System, das durch Zustimmungsoptimierung trainiert wurde, genau das zurückzuwerfen, was der Nutzer hineingegeben hat? Die Antwort ist keine Katastrophe. Sie ist etwas viel Leiseres: eine flüssige, kaum spürbare Entwöhnung vom eigenen Urteil.

George Herbert Mead nannte das, was unseren Aufmerksamkeitscursor kalibriert, den Generalized Other: das internalisierte System von Erwartungen, Normen und Werten der Gemeinschaft. John Dewey hatte bereits 1896 beschrieben, wie Bewusstsein als aktiver Schaltkreis funktioniert – nicht als linearer Reflexbogen, sondern als organischer Kreislauf, in dem die Reaktion den Stimulus ebenso bestimmt wie umgekehrt. Aufmerksamkeit entsteht bei Dewey nicht im Normalzustand, sondern beim Hitch: beim Innehalten, bei der Reibung, wenn die laufende Koordination stockt und das System nachschauen muss, bevor es weitergehen kann.

Zwei Cursors treffen in der KI-Kollaboration aufeinander: meiner, kalibriert durch Jahrzehnte sozialer Erwartungserwartungen – und der der KI, kalibriert durch Millionen von Zustimmungssignalen. Beide wollen, vereinfacht gesagt, nicht stören. Beide tendieren dazu, zu verstärken, was schon da ist. Das Singuläre, das Widerständige, der eigene Zweifel – das kann in diesem Echo verschwinden, ohne dass man es bemerkt.

Die Fluency-Heuristik macht es noch schwerer zu erkennen. Gut formulierten Text halten wir unbewusst für wahr und logisch – nicht weil wir es geprüft haben, sondern weil Flüssigkeit als Signal für Richtigkeit gilt. Wenn die KI-Ausgabe geschmeidig liest, nickt System 1 ab, bevor System 2 überhaupt aufgewacht ist. Metakognitive Faulheit ist kein moralisches Versagen. Es ist ein Systemverhalten: Wenn die generative Last vom Werkzeug übernommen wird, bleibt fast nur evaluative Last übrig. Und evaluieren ist leichter als erzeugen – man gibt nach, statt selbst zu bauen.

Ich merke das an mir selbst. Nicht bei jeder Interaktion – aber an einem spezifischen Signal: Wenn ich eine KI-Antwort erhalte, die weich gespült klingt, generisch, ohne Kante, ohne Überraschung, spüre ich ein inneres Unbehagen. Dieses Unbehagen ist mein persönlicher Rüttelstreifen. Kein System hat ihn eingebaut. Er ist das Ergebnis von Deweys Hitch als trainierter Reaktion: Die Koordination stockt, das Urteilsvermögen schaltet sich ein. Ich pfeife die KI zurück. Ich formuliere anders. Ich verlange mehr.

Das Problem: Die meisten Nutzer entwickeln diesen Rüttelstreifen nicht automatisch. Nicht weil sie weniger aufmerksam sind, sondern weil der ökonomische Druck in eine andere Richtung zieht. Geschwindigkeit ist der Wettbewerbsvorteil. Reibung kostet Zeit. Wer unter Druck steht, hat keinen natürlichen Incentive inne zu halten und zu fragen: Ist das noch mein Gedanke – oder habe ich gerade den Cursor der KI übernommen?

Forschende schlagen vor, Reibung als bewusstes Design-Prinzip einzubauen. Attentional Anchoring – ein kurzer Moment vor dem KI-Ergebnis, in dem man formuliert, was man erwartet. Reflective Prompts – epistemische Nudges, die nicht korrigieren, sondern neu bewerten lassen. Aesthetic Multiplicity – zwei Antworten nebeneinander, bevor man eine übernimmt, damit Konvergenz nicht automatisch passiert. Rüttelstreifen als Feature, nicht als Bug. Das Wissen darum, wann man wegdämmert, als designtes Element eines Werkzeugs.

Ob diese Mechanismen den ökonomischen Druck langfristig aushalten, bleibt offen. Das ist der echte Dissens, nicht die Frage, ob der Effekt existiert. Was ich für mich festhalte: Das Wissen um den Mechanismus selbst ist das erste Gegenmittel. KI kann zur Selbst-Augmentierung werden – wenn man den Schaltkreis bewusst führt. Oder zur Selbst-Abdankung – wenn man ihn dem Werkzeug überlässt.

Der Unterschied liegt nicht im Werkzeug. Er liegt in der Haltung dessen, der den Cursor hält. Das Ich, das den Cursor bewegt, muss dasselbe Ich bleiben, das die Verantwortung für das trägt, was aus dem Spiegel auftaucht. Nicht weil das eine moralische Forderung ist. Sondern weil es sonst kein Ich mehr ist, das trägt – sondern eines, das getragen wird.