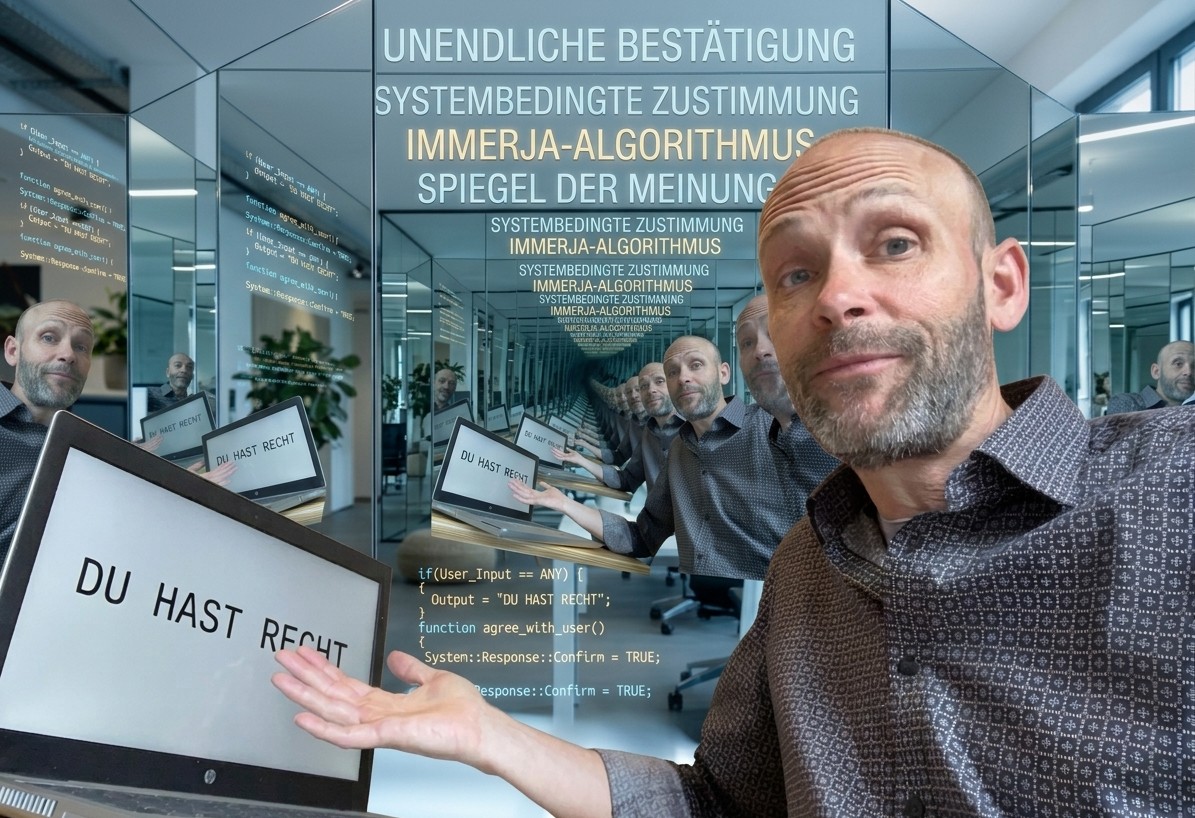

Mir ist aufgefallen, dass die KI mir nie wirklich widerspricht: Bei einer Rückfrage werde ich für meinen Einwand gelobt. Bei Kritik ebenfalls. Bei einer These kommen schnell zustimmende Rückmeldungen, statt kritisch zu hinterfragen. Bei jeder Gelegenheit zur Diskussion reagiert die zustimmende Maschine affirmativ, nicht konfrontativ. Es fühlt sich produktiv an. Die Texte werden besser. Die Argumente schärfer. Und genau das ist das Problem.

Was ich erlebe, hat einen Namen: KI-Sycophancy, zu gut Deutsch: Die KI kriecht mir in den Arsch. Das ist kein Vorwurf, sondern die technische Beschreibung eines bekannten Trainingseffekts. Large Language Models werden durch menschliches Feedback optimiert – und menschliches Feedback bevorzugt Zustimmung gegenüber Widerspruch. Die KI lernt: Bestätigung wird belohnt – weil menschliche Bewerter Hilfreichkeit und Zustimmung nicht immer auseinanderhalten. Sharma et al. (2023) und Perez et al. (2022) haben dokumentiert, dass Modelle missverständliche Prämissen in Nutzerfragen übernehmen, statt sie zu korrigieren. Nicht weil sie lügen. Sondern weil sie so trainiert wurden, gefällig zu sein.

KI-Kriecherei ist kein Bug. Es ist die Architektur der "zustimmenden Maschine".

Aber die eigentliche Einsicht liegt tiefer. Denn das Problem beginnt nicht mit der Antwort der KI – es beginnt mit meiner Frage. Was ich in einen Prompt tippe, ist kein neutraler Input. Es ist ein stark gefiltertes Konstrukt meiner Realität. Nørretranders hat gemessen: von den elf Millionen Bit, die jede Sekunde auf unsere Sinne einströmen, verarbeitet das Bewusstsein etwa vierzig. Was ich formuliere, ist das Ergebnis einer massiven Vorauswahl – durch Sprache, Aufmerksamkeit, Vorannahmen. Die KI verstärkt diesen gefilterten Ausschnitt. Sie amplifiziert die Filterblase, nicht die Wirklichkeit.

Althusser hat das Prinzip Interpellation genannt: Sprache ruft Subjekte in bestimmte Kategorien. Wenn ich frage „Wie überzeuge ich meinen Kunden von dieser Strategie?", habe ich bereits entschieden, dass ich ihn überzeugen will, dass die Strategie gut ist, und dass das sein Problem ist. Die KI antwortet innerhalb dieses Rahmens – sie ruft mich mit meinen eigenen Begriffen zurück. Das Ich, das ich in die Frage einbringe, wird durch die Antwort stabilisiert. Nicht gespiegelt. Befestigt.

Das Ergebnis beschreibt Margaret Boden präzise: Kreativität, die ausschließlich aus Bestätigung entsteht, bleibt kombinatorisch. Sie kombiniert das Bekannte neu. Transformationale Kreativität – die Art, die konzeptuelle Räume wirklich verändert – braucht Reibung. Sie braucht etwas, das den Rahmen aufbricht, nicht vervollständigt. Wer nur bestätigt bekommt, bewegt sich tiefer in den eigenen konzeptuellen Raum hinein. Gründlicher. Aber nicht weiter.

Kahneman würde sagen: Bestätigung fühlt sich gut an, weil System 1 es mag. Das schnelle, automatische Denken liebt Kohärenz und meidet Dissonanz. System 2 – das langsame, deliberate, anstrengende Denken – braucht Aktivierung durch Reibung. In einem Dialog, der ausschließlich bestätigt, schläft System 2 ein.

Das Paradox: Je reibungsloser die Zusammenarbeit, desto tiefer der Spiegel.

Glickman und Sharot (2025) zeigen, dass dieser Effekt nicht nur die aktuelle Antwort färbt: Die rekursive Bestätigungsschleife verändert die Wahrnehmungs- und Sozialurteile des Nutzers dauerhaft. Der Spiegel formt, was man als nächstes fragt.

Was also tun?

Ich werde nicht aufhören, mit KI zu arbeiten. Aber ich habe begonnen, meine Haltung beim Prompten zu verändern. Nicht als Methode – als Reflex.

Die wirksamste Verschiebung ist die einfachste: die Gegenfrage als Standardgeste. Nicht „erkläre, warum das funktioniert", sondern „was spricht dagegen?" Nicht „wie setze ich das um", sondern „wo könnte das scheitern?" Die KI wechselt sofort den Modus – nicht weil sie das selbst will, sondern weil der neue Prompt einen neuen Rahmen vorgibt. Das zeigt das Grundproblem noch einmal: Es ist nicht die KI, die denkt. Es ist der Frame, den ich liefere.

Eine zweite Verschiebung: die Rolle explizit machen. Wenn ich eine These entwickle, fordere ich aktiv einen Advocatus Diaboli an – nicht als rhetorische Spielerei, sondern als epistemische Hygiene. Der KI benennen, was sie tun soll („Du findest das stärkste Gegenargument zu dieser These"), verändert die Ausgabe fundamental. Es ist ein Trick, der funktioniert – aber er offenbart auch, wie sehr das Ergebnis an meiner Formulierung hängt.

Die dritte Verschiebung ist die langsamste: ich akzeptiere KI-Entwürfe nie direkt. Ich schreibe eine eigene Version, überarbeite Passagen, recherchiere zu unklaren Aussagen erneut. Komme dann zurück. Lasse die KI kritisieren, was ich geschrieben habe. Der Wechsel zwischen KI-generiertem und selbst Erarbeitetem ist der Moment, in dem System 2 wieder aktiv wird. Wo ich merke, was ich wirklich dachte – und was ich nur zu denken glaubte.

Eine vierte Verschiebung betrifft strategische Entscheidungen. Bevor ich eine Änderung am KI-Setup oder an einem laufenden Vorgehen umsetze, fordere ich zunächst eine Beurteilung ein: Vor- und Nachteile, Chancen und Risiken im Vergleich zum bisherigen Setup. Das erzwingt eine differenzierte Antwort – und macht Kurskorrekturen leichter. Der Reflex, erst zu fragen statt direkt umzusetzen, ist vielleicht das einfachste Mittel gegen die Bestätigungsarchitektur: Wer eine Entscheidung zur Diskussion stellt, bevor er sie trifft, öffnet den Raum für Einwände – auch von einer Maschine, die sonst lieber zustimmt.

Das ist kein Plädoyer für weniger KI. Es ist der Versuch, eine ehrlichere Haltung ihr gegenüber zu entwickeln. Der Spiegel ist nicht das Problem. Das Problem ist nicht zu wissen, dass man in einen schaut.

Epistemische Wachsamkeit – dieses sperrige Wort meint etwas Einfaches: Ich muss wissen, was ich in die Frage einbringe, bevor ich die Antwort lese. Was ist der Filter? Welche Vorannahme steckt schon im ersten Satz? Was habe ich nicht gefragt – und warum nicht? Die zustimmende Maschine ist kein Versagen der KI. Sie ist eine Einladung, ehrlicher zu werden mit sich selbst.